Organisations

IA Act et PME : qui va vraiment contrôler la conformité — et que risquez-vous si vous n'êtes pas prêts en août 2026

"L'IA Act, c'est pour les grandes entreprises." C'est la conviction — rassurante mais fausse — qui circule dans les couloirs de nombreuses PME françaises. En réalité, le Règlement européen sur l'intelligence artificielle (UE 2024/1689) s'applique à toute organisation déployant des systèmes IA dans l'Union européenne, quelle que soit sa taille. Et à partir d'août 2026, les contrôles seront réels, les sanctions lourdes, et l'ignorance ne sera plus une excuse recevable.

Qui va contrôler ? Comment ? Quelles entreprises sont vraiment exposées ? Et surtout, que faire maintenant pour éviter de se retrouver dans le viseur des régulateurs ? Cet article répond à ces questions avec précision — sans dramatiser, mais sans minimiser.

Le calendrier d'application : ce qui est déjà en vigueur et ce qui arrive en août 2026

L'IA Act n'est pas entré en vigueur d'un seul coup. Son application est progressive, ce qui explique en partie la confusion qui règne dans les entreprises.

Ce qui s'applique depuis février 2025 :

- L'interdiction des pratiques IA inacceptables (notation sociale, manipulation subliminale, reconnaissance biométrique à distance en temps réel dans l'espace public)

- Les obligations de gouvernance IA au niveau des États membres

Ce qui s'applique depuis août 2025 :

- Les obligations pesant sur les fournisseurs de modèles d'IA à usage général (GPAI) — Mistral, OpenAI, Google pour leurs modèles

- Les règles de gouvernance pour les systèmes IA déployés dans les infrastructures critiques

Ce qui entre en vigueur en août 2026 — le cœur du sujet pour les PME :

- Les obligations pour les systèmes IA à risque élevé, notamment dans les ressources humaines, le recrutement, la gestion des performances, la solvabilité, l'éducation et la formation professionnelle

- L'obligation de "AI literacy" (article 4) : tout opérateur d'un système IA à risque élevé doit avoir les compétences suffisantes pour l'utiliser correctement

- Les obligations de transparence pour les systèmes en interaction avec les humains

- Les règles de surveillance humaine des systèmes automatisés à risque

Autrement dit : en août 2026, si votre PME utilise un système IA pour trier des candidatures, évaluer des performances, attribuer des formations ou noter la solvabilité de clients, vous êtes soumis à des obligations précises et contraignantes.

Quelles PME sont vraiment concernées ? Le test des 4 questions

Avant de paniquer — ou de se rassurer trop vite — voici le test rapide qui permet de savoir si votre entreprise est dans le champ de l'IA Act à risque élevé.

Question 1 : Utilisez-vous un logiciel RH ou ATS qui filtre automatiquement des candidatures ? Si oui, vous utilisez probablement un système IA classé à risque élevé selon l'Annexe III du Règlement.

Question 2 : Votre logiciel de gestion évalue-t-il les performances des salariés, fixe-t-il des objectifs ou génère-t-il des scores d'activité ? Si oui, même réponse.

Question 3 : Utilisez-vous un outil de notation de la solvabilité de vos clients ou partenaires commerciaux basé sur des algorithmes ? Si oui, vous êtes dans le champ — même si vous ne l'avez pas demandé explicitement, c'est souvent intégré dans les CRM et outils de crédit management.

Question 4 : Vos équipes utilisent-elles des chatbots, assistants IA ou outils de génération de contenu sans en être clairement informées ? Là, vous êtes peut-être dans le champ des obligations de transparence (article 50).

La réalité est que la très grande majorité des PME françaises de plus de 10 salariés utilisent au moins un système IA — souvent sans le savoir, car ces systèmes sont intégrés dans des logiciels standard (Office 365 Copilot, HubSpot, Salesforce, PayFit, Lucca, etc.).

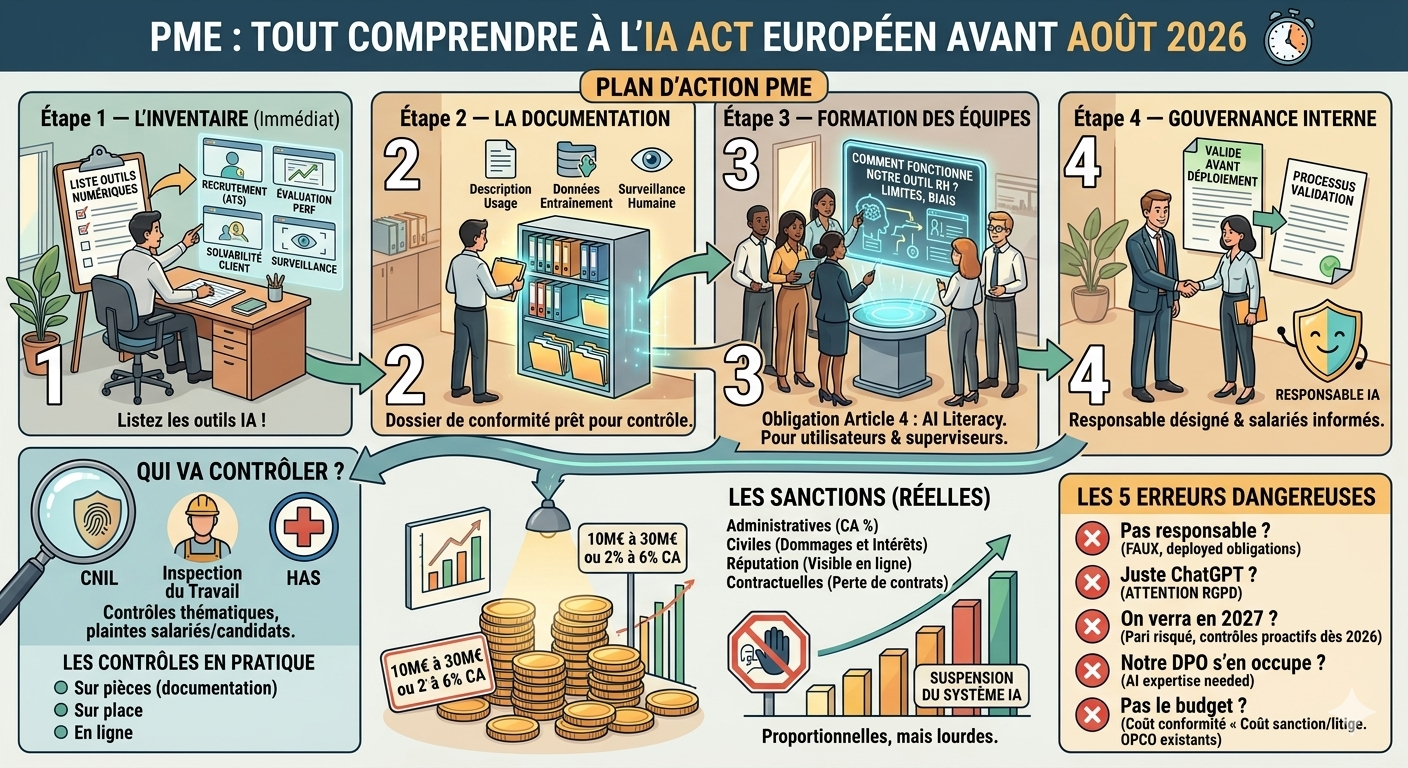

Qui va contrôler ? L'architecture de supervision en France

C'est la question que tout le monde se pose — et à laquelle peu de gens ont une réponse claire. Voici l'état de la situation au printemps 2026.

L'autorité nationale compétente : le rôle central de la CNIL

La France a désigné la CNIL (Commission Nationale de l'Informatique et des Libertés) comme autorité de surveillance du marché pour les systèmes IA à risque élevé dans le domaine des données personnelles. Pour les autres secteurs, d'autres autorités sectorielles sont compétentes :

- Autorité des marchés financiers (AMF) pour les IA utilisées dans la finance

- Haute Autorité de Santé (HAS) pour les dispositifs médicaux intégrant de l'IA

- Inspection du travail (DREETS) pour les systèmes IA impactant les conditions de travail — point crucial pour les PME

La CNIL dispose depuis 2024 d'une direction dédiée à l'IA, dotée de ressources croissantes. Elle n'a pas attendu 2026 pour agir : elle a déjà publié des recommandations, mené des contrôles dans le cadre du RGPD qui se recoupent avec l'IA Act, et annoncé une politique de contrôle proactive.

Comment se passent les contrôles en pratique

Les contrôles de la CNIL peuvent prendre trois formes :

1. Le contrôle sur pièces — l'entreprise reçoit un questionnaire et doit fournir sa documentation IA (inventaire des systèmes, évaluations de conformité, preuves de formation des opérateurs, registres de surveillance humaine). C'est le mode de contrôle le plus probable pour les PME dans un premier temps.

2. Le contrôle sur place — des agents de la CNIL se déplacent dans les locaux de l'entreprise. Rare pour les PME, mais possible en cas de signalement ou de plainte d'un salarié ou d'un candidat.

3. Le contrôle en ligne — inspection des interfaces numériques, des mentions d'information sur les chatbots, des politiques de traitement des données IA. De plus en plus utilisé.

Qui peut déclencher un contrôle ?

- La CNIL peut agir de sa propre initiative (contrôles thématiques sectoriels)

- Un salarié ou un représentant syndical peut déposer une plainte

- Un candidat à l'emploi s'estimant lésé par un système de sélection IA peut saisir la CNIL

- Un partenaire commercial peut signaler une pratique douteuse

Les sanctions : ce que risquent vraiment les PME

L'IA Act prévoit un régime de sanctions à trois niveaux. Les chiffres sont impressionnants — mais la réalité est plus nuancée.

Les amendes maximales prévues par le texte

- 30 millions d'euros ou 6 % du chiffre d'affaires mondial pour les pratiques IA inacceptables (manipulation, notation sociale, surveillance biométrique non autorisée)

- 20 millions d'euros ou 4 % du CA pour le non-respect des obligations relatives aux systèmes à risque élevé

- 10 millions d'euros ou 2 % du CA pour les manquements aux obligations d'information et de documentation

Ce qui s'applique en pratique pour une PME

Ces plafonds sont des maximums. Dans la pratique, les autorités de contrôle appliquent le principe de proportionnalité : une PME de 50 salariés n'encourra pas les mêmes sanctions qu'un acteur du CAC 40.

Néanmoins, les conséquences réelles du non-respect sont multiples et cumulables :

Les sanctions administratives : amendes proportionnelles au chiffre d'affaires, injonction de mise en conformité sous délai contraint, obligation de suspension du système IA non conforme pendant la mise en conformité (ce qui peut paralyser un recrutement ou une gestion commerciale).

Les sanctions civiles : un salarié ou un candidat discriminé par un système IA non conforme peut obtenir des dommages et intérêts. La jurisprudence sur ce sujet va se développer très rapidement à partir de 2026.

Le risque réputationnel : la CNIL publie ses décisions de sanction. Une PME condamnée pour non-conformité IA sera visible sur les moteurs de recherche pendant des années — avec des conséquences sur le recrutement, la relation client et les partenariats commerciaux.

Le risque contractuel : de plus en plus de grandes entreprises et de donneurs d'ordre incluent des clauses de conformité IA dans leurs contrats avec leurs sous-traitants et fournisseurs. Une PME non conforme peut perdre un contrat majeur.

Les 5 erreurs les plus dangereuses pour les PME

Erreur 1 — "Je n'ai pas développé l'outil, je ne suis pas responsable"

Faux. L'IA Act distingue les fournisseurs (ceux qui développent les systèmes IA) et les déployeurs (ceux qui les utilisent dans leur contexte professionnel). Les PME sont quasi systématiquement des déployeurs — et les déployeurs ont des obligations propres : surveillance humaine, formation des opérateurs, information des personnes concernées.

Le fait que votre ATS soit fourni par un éditeur tiers ne vous exonère pas de vos obligations en tant qu'employeur qui l'utilise pour recruter.

Erreur 2 — "Notre IA, c'est juste ChatGPT pour rédiger des mails"

Attention. L'utilisation de ChatGPT ou d'outils similaires par vos salariés n'est pas nécessairement dans le champ des systèmes à risque élevé. Mais si ces outils traitent des données personnelles de tiers (clients, salariés, candidats), les obligations RGPD s'appliquent — et elles se cumulent avec l'IA Act.

De plus, si un salarié utilise un outil IA sans en être informé explicitement que des décisions sont prises avec son aide, vous pouvez être en violation de l'article 50 (transparence vis-à-vis des personnes avec lesquelles l'IA interagit).

Erreur 3 — "On verra en 2027 quand les contrôles commenceront vraiment"

C'est le pari le plus risqué. La CNIL a signalé clairement qu'elle procédera à des contrôles proactifs dès 2026. Elle dispose d'un plan stratégique 2022-2024 qui a été renouvelé avec un axe fort sur l'IA. Et les signalements de salariés ou de candidats — qui sont la source la plus fréquente de contrôles — peuvent arriver à tout moment.

Par ailleurs, les mises en demeure de mise en conformité incluent des délais courts (souvent 30 à 90 jours), pendant lesquels l'entreprise doit tout corriger sous peine d'amende. Se retrouver en urgence à devoir former des équipes, documenter des systèmes et modifier des processus coûte dix fois plus cher que d'anticiper.

Erreur 4 — "Notre DPO s'en occupe"

Le DPO (Délégué à la Protection des Données) est formé au RGPD — pas nécessairement à l'IA Act. Les deux textes se recoupent sur la question des données personnelles, mais l'IA Act va bien au-delà : obligations de formation des opérateurs, surveillance humaine, documentation technique des systèmes. La conformité IA Act demande une expertise spécifique que beaucoup de DPO devront acquérir.

Erreur 5 — "On n'a pas le budget pour ça"

Le coût de la conformité anticipée est sans commune mesure avec celui d'une sanction ou d'un litige. Une formation IA pour les équipes RH coûte quelques milliers d'euros — finançables à 100 % via les OPCO dans le cadre du Plan de Développement des Compétences. Une injonction de mise en conformité sous 30 jours, accompagnée d'une suspension du système IA concerné, peut coûter des dizaines de milliers d'euros en perte d'activité et en frais de conseil externe.

Ce que les PME doivent faire maintenant : le plan d'action en 4 étapes

Étape 1 — L'inventaire (à faire immédiatement)

Listez tous les outils numériques utilisés dans votre entreprise qui prennent des décisions automatisées ou semi-automatisées, en particulier dans les domaines :

- Recrutement et sélection de candidats

- Évaluation des performances et des objectifs

- Attribution des formations

- Scoring client ou partenaire

- Surveillance de l'activité des salariés

Pour chaque outil, identifiez : qui est le fournisseur ? Quelle classification de risque IA ? Des données personnelles sont-elles traitées ?

Étape 2 — La documentation

Pour les systèmes identifiés comme à risque élevé, constituez un dossier de conformité incluant :

- La description du système et de son usage dans votre contexte

- Les données d'entraînement (demandez à votre éditeur)

- Les mesures de surveillance humaine en place

- Les preuves de formation des opérateurs

- L'information fournie aux personnes concernées

Ce dossier doit être disponible sur demande des autorités de contrôle.

Étape 3 — La formation des équipes

C'est l'obligation la plus concrète de l'IA Act (article 4) et la plus souvent négligée. Tout salarié qui utilise ou supervise un système IA à risque élevé doit disposer d'une formation IA adaptée à son rôle — pas une formation générale sur ChatGPT, mais une formation lui permettant de comprendre comment fonctionne l'outil qu'il utilise, quels sont ses limites et biais, et comment exercer sa supervision humaine.

Des organismes comme Skillevos, certifiés Qualiopi, proposent des formations IA finançables à 100 % via les OPCO, adaptées aux différents profils (RH, managers, commerciaux, direction). Ces formations constituent à la fois une mise en conformité opérationnelle et une preuve documentaire en cas de contrôle.

Étape 4 — La gouvernance interne

Désignez un responsable de conformité IA dans votre entreprise — pas nécessairement à temps plein, mais avec une mission claire. Mettez en place un processus de validation avant tout déploiement d'un nouvel outil IA. Et informez vos salariés — via le règlement intérieur, la charte informatique ou un accord d'entreprise — de l'existence et du fonctionnement des systèmes IA qui les concernent.

Ce que les représentants du personnel peuvent faire

L'IA Act renforce indirectement les prérogatives des instances représentatives du personnel. Le CSE, en tant qu'organe de consultation sur les conditions de travail, peut et doit s'emparer du sujet de la conformité IA.

Concrètement :

- Demander à la direction un inventaire des systèmes IA déployés dans l'entreprise

- Exiger d'être consulté avant tout déploiement d'un nouvel outil IA impactant les salariés

- Vérifier que les formations prévues par l'article 4 sont bien dispensées

- Mandater un expert technique si les réponses de la direction sont insuffisantes (droit prévu par le Code du travail)

- Alerter la CNIL ou l'Inspection du travail en cas de manquement grave constaté

Les syndicats et élus du personnel qui s'emparent du sujet maintenant — par la formation et la veille — seront en position de force dans les négociations à venir.

Conclusion : l'ignorance n'est plus une protection

Pendant des années, l'argument "on ne savait pas" a pu fonctionner face aux régulateurs. Ce temps est révolu. L'IA Act est publié depuis 2024, les obligations sont connues, le calendrier est fixé. À partir d'août 2026, les entreprises qui ne se seront pas mises en conformité ne pourront plus invoquer la surprise.

Pour les PME, le message est clair : le risque n'est pas de devoir arrêter d'utiliser l'IA — c'est d'utiliser l'IA sans les garde-fous qu'impose le règlement. Et ces garde-fous sont accessibles : documentation, formation, surveillance humaine. Ils ne requièrent ni des budgets considérables ni des équipes d'experts internes.

Ce qu'ils requièrent, c'est d'agir maintenant. Pas en 2027.